Süni intellekt müxtəlif fəaliyyət sahələrində möhkəm yer tutub və elm də istisna deyil. Bir çox alim elmi məqalələrin yazılması prosesində ondan fəal istifadə edir. Buna görə də elmi jurnallar məqalələri nəşr etməzdən əvvəl süni intellekt izləri üçün diqqətlə yoxlayır. Lakin belə detektorlar həqiqətən effektivdirmi? Onlar nəticələrin etibarlılığına 100% zəmanət verirmi? Bu gün bu barədə daha ətraflı danışacağıq.

AI detektorları: onlar effektivdirmi?

Akademik dürüstlük prinsiplərinə riayət etmək elmi fəaliyyətin təməlidir. Buna görə də elmi jurnallar məqaləni rəy üçün göndərməzdən əvvəl süni intellekt istifadəsinin mümkün əlamətləri üçün yoxlayırlar. Bu məqsədlə mətni təhlil edən və onun unikalığı barədə hesabat verən xüsusi alətlər mövcuddur. Lakin praktikada belə süni intellekt detektorları qüsursuzluqdan uzaqdır. Əksinə, onların nəticələrin obyektivliyinə ciddi təsir göstərə biləcək çoxlu çatışmazlıqları var. Onlar özünü necə göstərirlər?

Eksiklik 1: akademik üslub səbəbindən yalnış müsbət nəticələr

Elmi mətnlər mahiyyət etibarilə üslubca oxşardır, çünki onlar mövcud terminlərdən, tipik cümlə quruluşlarından və neytral tondan istifadə edirlər. Analiz prosesi zamanı detektorlar bu xüsusiyyətləri, xüsusilə təkrarlanan dil nümunələrini, rəsmi təqdimatı və aydın strukturu axtarır. Bunlar mətnin müəllifinin insan deyil, süni intellekt əsaslı vasitə olduğunu göstərməli olan "markerlər" adlanır.

Bu bir paradoks yaradır: elmi üslubda səlis yazan, düzgün terminologiyadan istifadə edən və standartlara riayət edən müəllif avtomatik olaraq şübhə altına düşür. Məqalə nə qədər yaxşı yazılsa, detektorun onu süni intellekt tərəfindən yaradılmış mətn kimi səhv tanıması ehtimalı bir o qədər artır. Nəticədə saxta müsbət nəticələr və yüksək süni intellekt istifadəsi faizi yaranır.

2-ci çatışmazlıq: müəlliflərin AI texnologiyasından necə istifadə etdiklərini səhv başa düşmək

Elmi ictimaiyyətdə tədqiqatçıların süni intellekt texnologiyasından yalnız məqalənin tam mətnini yaratmaq üçün istifadə etdikləri barədə bir təsəvvür var. Lakin bu əslində yanlış təsəvvürdür, çünki müasir alimlər süni intellektdən işlərinin müxtəlif mərhələlərində köməkçi kimi istifadə edirlər, məsələn, beyin fırtınası zamanı ideyalar yaratmaq, böyük həcmdə məlumatı strukturlaşdırmaq, mürəkkəb ifadələri yenidən formalaşdırmaq, xarici dil mətnlərindəki qrammatikanı düzəltmək və ya fəsillərin oxunmasını yaxşılaşdırmaq üçün. Bu, alətin hədəflənmiş, şüurlu istifadəsidir; əsas ideyalar, metodologiya və nəticələr müəllifə məxsus qalır.

Lakin detektorlar bu fərqi görmür. Alqoritm üçün fərqi yoxdur ki, məqaləni tamamilə tək bir sorğu ilə yaradıb, yoxsa dil modelini yalnız iki cümləni təkmilləşdirmək üçün istifadə etmisiniz. Hər hansı köməkçi texnologiyadan istifadə məqaləni avtomatik olaraq "süni intellekt tərəfindən yazılıb" kimi işarələyir, bu isə doğru deyil.

3-cü çatışmazlıq: müəllifin faktiki töhfəsini qiymətləndirə bilməmək

Yuxarıda qeyd etdiyimiz kimi, süni intellekt getdikcə insan düşüncəsinin əvəzedicisi olmaqdan daha çox, alimlərə fikirlərini daha yaxşı ifadə etməyə kömək edən texniki köməkçi rolunu oynayır. Məsələn, riyaziyyatçı hesablamalar üçün kalkulyator istifadə edəndə, bu, onun tədqiqatın müəllifi olmadığı anlamına gəlmir.

Oxşar şəkildə, mətnin redaktə və ya formatlaşdırılması üçün dil modellərindən istifadə müəllifin işə qoyduğu zəhməti ləğv etmir. Lakin detektorlar bunu qiymətləndirə bilmir. Onlar müəllifin metodologiyanı özü hazırlayıb-hazırlamadığını, təcrübəni aparıb-aparmadığını, məlumatları təhlil edib nəticələr çıxarıb-çıxarmadığını (AI-dən yalnız mətnin texniki təkmilləşdirilməsi üçün istifadə edərək) və ya sadəcə bütün məqaləni avtomatik yaradıb-yaradmadığını ayıra bilmirlər. Bu məhdudiyyət elmi işin keyfiyyəti və orijinallığı barədə yanlış nəticələrə gətirib çıxarır.

Çatışmazlıq 4: Akademik mühitdə ciddi etik problemlərin yaranması

Detektorlar elmi işləri səhvən süni intellekt tərəfindən yaradılmış kimi müəyyən etdikdə, bu, etik münaqişələr zəncirinin yaranmasına səbəb olur. Müəlliflər, tədqiqatlarında dürüstcə çalışsalar da, akademik dürüstlüyü pozmaqda haqsız yerə ittiham oluna bilərlər. Bu, alimlərlə jurnal redaktorları arasındakı etimadı sarsıdır və tədqiqatçıların elmi nüfuzuna zərər verə bilər.

Gənc alimlər və ya xarici dildə nəşr edənlər xüsusilə həssasdır, çünki onların mətnləri daha süni dil səbəbindən və ya texnologiyadan istifadə edərək üslublarını cilalamağa cəhd etmələri səbəbindən şübhə altına alınmağa daha çox meyllidir. Bundan əlavə, yalan ittihamlar yüksək keyfiyyətli tədqiqatların rədd edilməsinə, nəşrin gecikməsinə və itirilmiş karyera imkanlarına səbəb ola bilər. Həqiqi müəllifliyi müəyyən etmək avtomatik proqram yoxlamasından daha dərin təhlil tələb edir.

Yİ detektorlarının işindəki səhv nümunələri

Yİ detektorlarının qeyri-sabitliyinin praktikada necə təzahür etdiyini anlamaq üçün üç real hadisəyə baxaq.

Praktiki nümunə 1: düzəlişlərdən sonra nəticələrin pisləşməsi

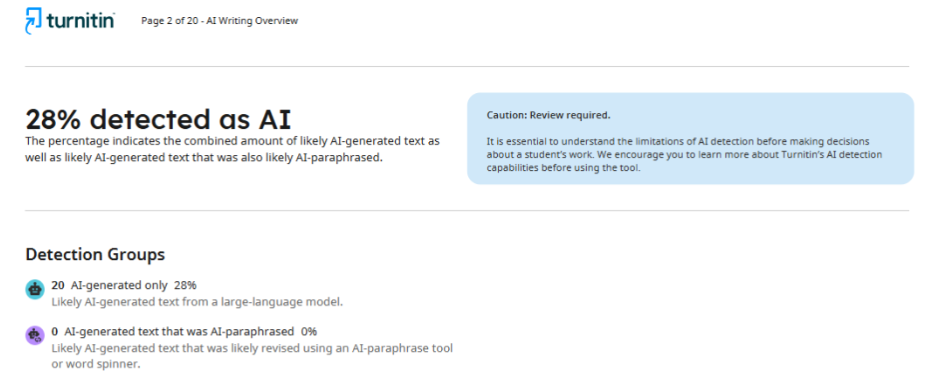

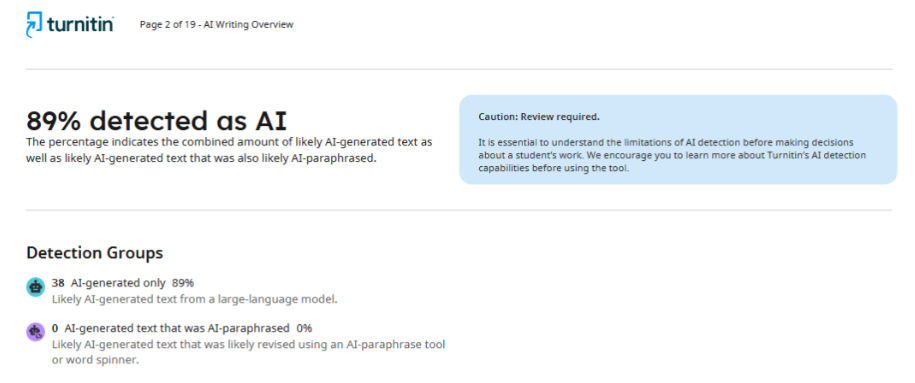

Bu halda elmi məqalənin müəllifləri Yİ detektorlarının etibarsızlığını açıq-aydın göstərən bir vəziyyətlə qarşılaşıblar. Jurnalın ilkin icmalı məqalədə AI istifadəsinin 28% ehtimalını göstərdi. Redaktorlar bu rəqəmin 20%-ə endirilməsini tələb etdilər və müəyyən mətn parçaları "AI-tipli" kimi işarələnmiş ətraflı hesabat təqdim etdilər.

Müəlliflər yalnız detektorun problemli hesab etdiyi parçaları yenidən yazdılar, mətnin qalan hissəsini toxunmadan saxladılar. Lakin yenidən yoxlamadan sonra eyni jurnal 89% nəticə ilə hesabat təqdim etdi. Əslində, gözlənilən azalmanın əvəzinə göstərici üç dəfədən çox artdı.

Bu vəziyyət süni intellekt detektorlarının əsas problemlərindən birini göstərir: onlar sabit qiymətləndirmə meyarlarına malik deyil və düzəlişlərdən sonra belə qeyri-sabit nəticələr göstərirlər.

Praktiki nümunə 2: eyni mətn üçün fərqli nəticələr

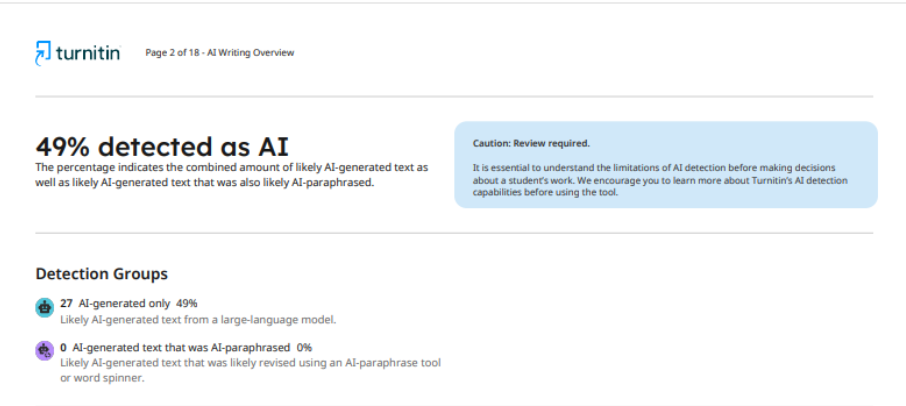

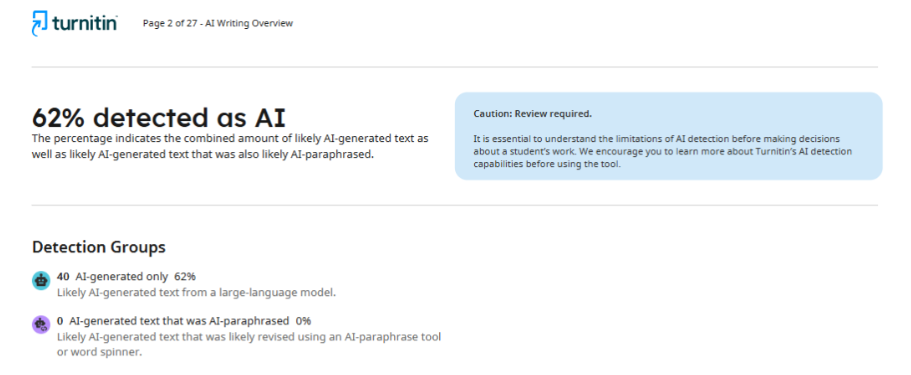

Daha da bariz nümunə odur ki, eyni sistemlə yoxlanılmış eyni məqalənin fərqli jurnallarda tamamilə fərqli nəticələri olub. Birinci elmi nəşrdə sistem süni intellektdən 49% istifadəni göstərib.

İkinci jurnala gəlincə, məqalə yoxlanıldıqdan sonra müəllifə süni intellektdən 62% istifadə edildiyini göstərən hesabat təqdim edib. Nəticələr arasındakı belə ziddiyyət göstərir ki, detektorlar sabit və dəqiq qiymətləndirmə təmin edə bilmir və yazı prosesində süni intellekt texnologiyalarından istifadə olunub-olunmadığını müəyyən etmək qabiliyyətləri şübhə altındadır.

Praktiki nümunə 3: müxtəlif proqramların nəticələrindəki fərqlər

Qeyd etmək lazımdır ki, bütün elmi jurnalların istifadə edəcəyi universal proqram mövcud deyil. Hər bir elmi nəşriyyat süni intellekt izlərini yoxlamaq üçün alətləri müstəqil şəkildə seçir. Məhz bu amil nəticələrin obyektivliyinə ciddi təsir göstərir.

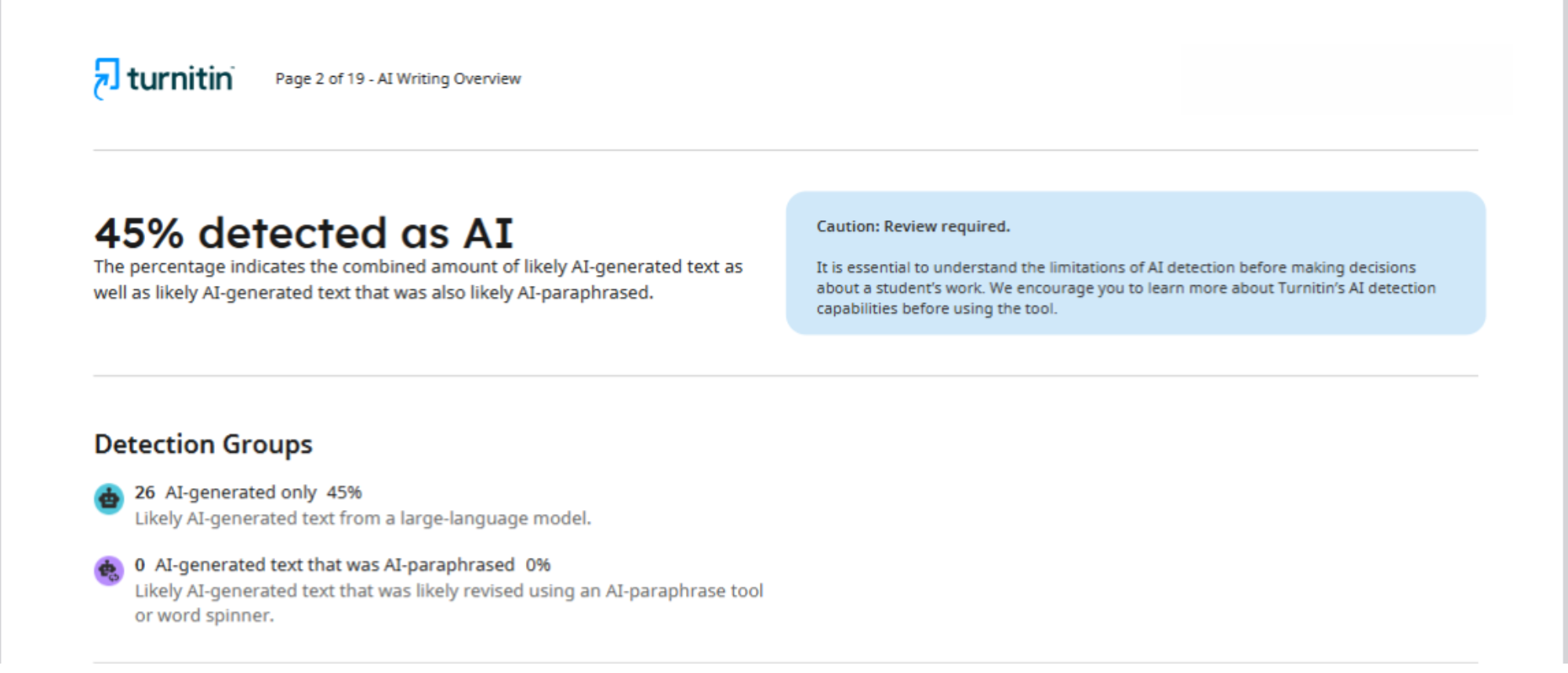

Məsələn, bu halda bir məqalənin təhlili üçün iki fərqli detektordan – Turnitin və Pangram-dan istifadə olunub. Birinci platformanın təqdim etdiyi hesabatda mətnin 45%-nin süni intellekt tərəfindən yaradıldığı göstərilir.

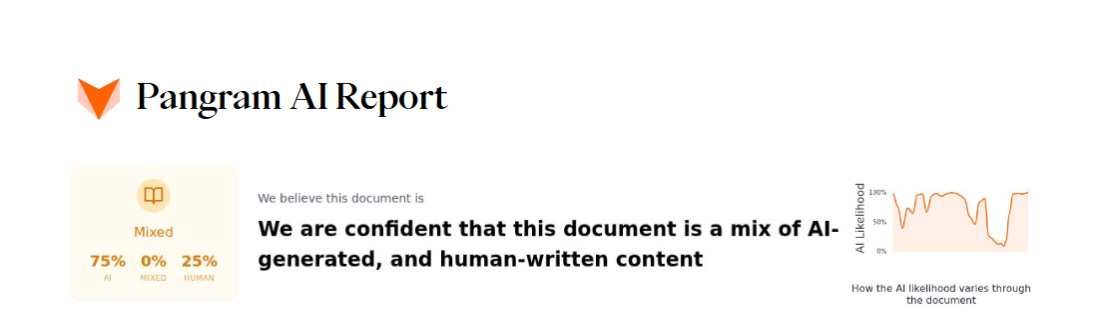

Pangram isə məqalənin 75%-nin süni intellekt nəticəsi olduğunu müəyyən edib. Gördüyümüz kimi, əldə olunan nəticələr arasındakı fərq böyükdür.

Bu vəziyyət açıq-aydın göstərir ki, hər bir mətnin yoxlanılması alətinin yaradılmış məzmunu tanımağa dair öz alqoritmləri, meyarları və yanaşmaları var. Tək tipli aşkarlama standartlarının olmaması o deməkdir ki, elmi məqalənin taleyi onun real keyfiyyətindən və orijinallığından asılı olmayıb, müəyyən bir jurnalın hansı proqramı seçməsindən asılı ola bilər.

AI aşkarlama alətlərinə etibar etmək olarmı?

Verilmiş nümunələr və yuxarıda qeyd olunan çatışmazlıqlar göstərir ki, müasir süni intellekt aşkarlama alətlərinin əhəmiyyətli məhdudiyyətləri və qeyri-dəqiqlikləri var ki, bu da onların qiymətləndirmənin yeganə meyarı kimi etibarlılığını şübhə altına alır. Onlar qeyri-sabit nəticələr verə, texnologiyanın istifadə olunduğu konteksti həmişə nəzərə almaya və bəzən yaxşı yazılmış akademik mətnləri səhvən süni intellekt tərəfindən yaradılmış kimi müəyyən edə bilərlər. Eyni mətnin müxtəlif yoxlamalarda fərqli qiymətləndirmələr alması və işarələnmiş parçaları düzəltmək cəhdlərinin gözlənilməz nəticələr verməsi göstərir ki, bu alətlər hələ tələb olunan dəqiqlik səviyyəsinə çatmayıb.

Buna görə də nəşr qərarları verərkən onlardan əsas və ya yeganə meyar kimi istifadə etmək risklidir. Hətta bu sistemlərin öz inkişaf etdiriciləri də qeyd edirlər ki, proqramları mükəmməl deyil və səhvlər edə bilər, yoxlamanın nəticəsi isə mətnin mənşəyi barədə yalnız ehtimalçı fərziyyədir, qəti sübut deyil.

Əvvəlcə və ən əsası, akademik icma süni intellektin etik istifadəsi ilə bağlı şəffaf siyasətlər hazırlamalı, əsasən məzmunun orijinallığının, metodologiyanın və müəllifin elmi töhfəsinin qiymətləndirilməsinə diqqət yetirməlidir. Yalnız bu cür yanaşma müasir texnologiyaların sürətli inkişafına uyğunlaşarkən akademik dürüstlüyü qoruyacaq.